图片生成精准动态视频,阿里、港大推出新模型LivePhoto

添加书签

专注AIGC领域的专业社区,关注微软OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

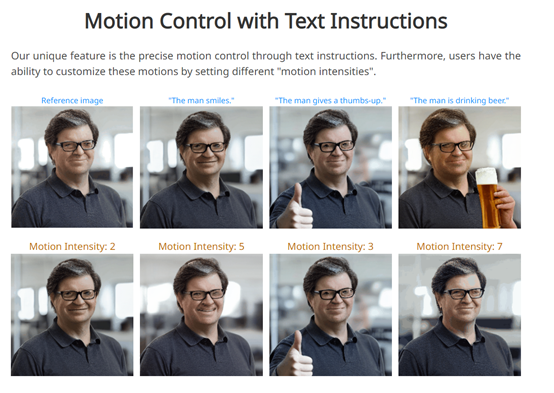

案例展示

本文素材来源LivePhoto论文,如有侵权请联系删除

END

本篇文章来源于微信公众号: AIGC开放社区

专注AIGC领域的专业社区,关注微软OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

案例展示

本文素材来源LivePhoto论文,如有侵权请联系删除

END

本篇文章来源于微信公众号: AIGC开放社区

Become a Member today!

Already an IQPC Community Member?

Sign in Here or Forgot Password

Sign up now and get FREE access to our extensive library of reports, infographics, whitepapers, webinars and online events from the world’s foremost thought leaders.

We respect your privacy, by clicking 'Subscribe' you will receive our e-newsletter, including information on Podcasts, Webinars, event discounts, online learning opportunities and agree to our User Agreement. You have the right to object. For further information on how we process and monitor your personal data click here. You can unsubscribe at any time.