不用GPU,也能运行!开源代码模型Stable-code-3b

添加书签

专注AIGC领域的专业社区,关注微软&OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

1月17日,著名开源生成式AI平台Stability.ai在官网开源了——Stable-code-3b。

虽然Stable-code-3b的实际参数只有27.9亿,但其性能可以与CodeLLaMA 70亿相媲美,甚至在多个测试领域实现了超越。

值得一提的是,没有GPU的笔记本也能运行Stable-code-3b模型,支持离线运行,整体能耗非常低适用于任何群体。

开源地址:https://huggingface.co/stabilityai/stable-code-3b

架构方面,Stable-code-3b是在之前的Stable-code基础之上开发而成,同样是基于 Transformer 解码器架构的自回归语言模型,支持文本问答方式生成代码。

训练数据方面,Stable-code-3b接受了1.3万亿标记的特定语言、代码数据集行了训练。

这些数据集包括:falcon-refinedweb、commitpackft和Github Issues,stability.ai同时使用了自有的数学数据集对其进行了补充,增强模型的推理能力。

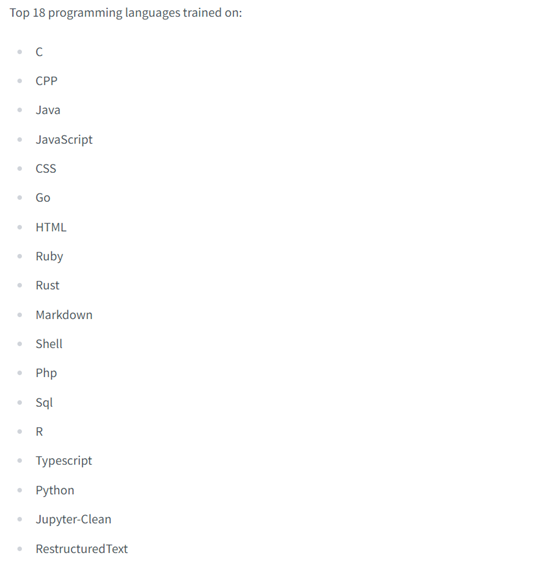

Stable-code-3b同时接受了C、JavaScript、Java、Python、PHP、HTML、GO等18种主流编程语言的训练,所以,在编程方面非常高效、适用范围广。

商用方面,拥有stability.ai会员资格的单位,可以将Stable-Code-3B实现商业化。

Stable-Code-3B适用于多种语言,并具有支持中间填充功能(FIM)和扩展上下文大小等额外优势。

Stable-Code-3B在多达16,384个token的序列上进行了训练,但遵循与CodeLlama相似的方法,实现了旋转嵌入。这也就是说,Stable-Code-3B可支持10万token序列。

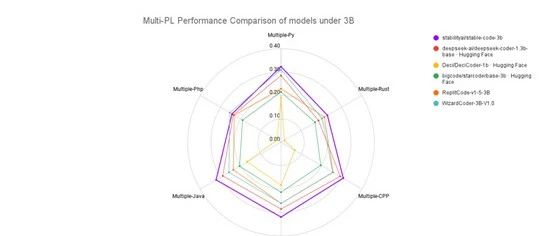

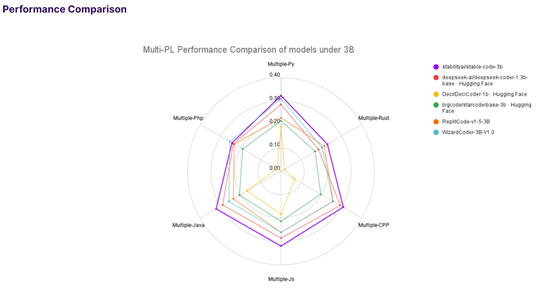

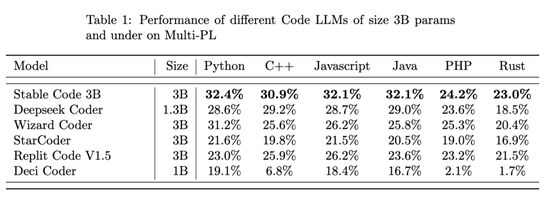

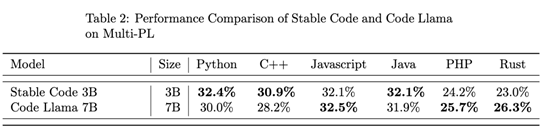

测试方面,Stable-Code-3B与Deepseek Coder、Wizard Coder Star Coder、Replit Code V1.5等知名小参数代码模型进行了全方位的比较。

在Python、C++、Javascript、Java、PHP和Rust知名编程语言的测试中,Stable-Code-3B皆取得了压倒性成绩。

在与Code Llama 7B的测试中,Stable-Code-3B在Python、C++、Java三种编程语言比其更好,整体性能几乎差不多。

本文素材来源Stability.ai官网,如有侵权请联系删除

END

本篇文章来源于微信公众号: AIGC开放社区