开源、可商用,仅需0.5秒图片直接生成3D模型!

添加书签

专注AIGC领域的专业社区,关注微软&OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

3月5日,著名开源大模型平台Stability.ai与Tripo AI联合开源了——TripoSR。

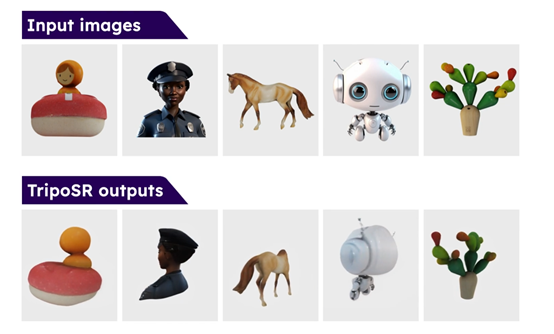

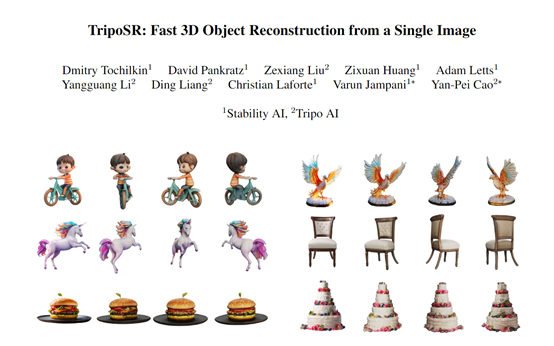

用户通过TripoSR仅需0.5秒(在英伟达A100 GPU)就能将一张图片直接生成高质量3D模型。

如果使用低效率推理模式,即便不用GPU也能生成3D模型,这对于个人开发者、小型企业来说能节省不少资源。

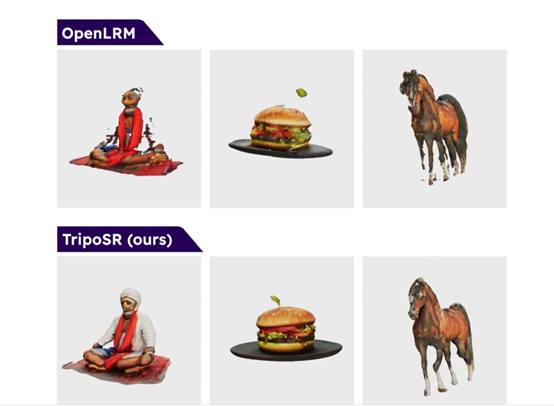

目前,TripoSR已经全面开源,支持商业化和学术研究。其性能优于OpenLRM等开源模型,可应用在游戏开发、工业设计、广告等领域。

开源地址:https://github.com/VAST-AI-Research/TripoSR

在线demo:https://huggingface.co/spaces/stabilityai/TripoSR

技术报告:https://stability.ai/s/TripoSR_report.pdf

TripoSR是一种基于Transformer架构的前馈3D重建模型,大幅度优化了模型迭代生成的流程,同时保留了模型精确控制输出的能力。一共由图像编码器、图像到三平面解码器和NeRF三大块组成。

图像编码器

图像编码器的作用主要是从输入图像中提取全局和局部特征,并转化为潜在向量序列。TripoSR采用了基于卷积的视觉变换器模型 ,DINOv1作为图像编码器的初始化模块。

DINOv1经过大规模图像数据集的预训练,学习到了丰富的视觉特征表示能力。

在TripoSR中,DINOv1将输入图像投影为一系列潜在向量,这些向量编码了图像的全局语义信息和局部细节信息,为后续3D模型重建奠定了基础。

图像到三平面解码器

图像到三平面解码器用于接收图像编码器输出的特征向量序列,并将其解码到3D场景中的三平面NeRF表示。

三平面NeRF表示使用了体渲染技术,将物体表面沿坐标平面展开为三个特征平面。相比于传统的体素表示,三平面更加紧凑高效,同时具有很强的表达能力,可以精细刻画复杂物体的形状和表面细节。

此外,在解码器中一系列的变换器编码层会对潜在向量进行解码变换。每个编码层包含自注意力和交叉注意力两个关键机制。

自注意力机制允许解码器内部关注三平面NeRF中的不同区域,捕捉不同部分之间的相关性;

而交叉注意力则让解码器关注来自图像编码器的特征向量,将图像的语义和细节信息融合到三平面NeRF表示中。

通过多层编码变换和注意力机制,原始的图像特征向量被成功转化为高保真的三平面NeRF表示,为生成最终的3D模型做好了准备。

NeRF模型

NeRF (神经辐射场)模块主要负责最后的3D图像生成:输入是三平面NeRF表示和采样的3D空间坐标点,输出则是该坐标点的颜色值和密度值。

NeRF中的多层感知机结构赋予了体渲染过程足够的建模能力,能精准地重构出3D物体全貌。

再通过体渲染技术对空间中的3D坐标位置进行密集采样,并基于NeRF模型预测的颜色密度信息,最终合成出完整的3D渲染图像。

相比传统的网格渲染方法,体渲染技术能更精细地还原物体表面的细节和自阴影效果,从而产生更加真实的3D重建效果。

本文素材来源TripoSR技术报告,如有侵权请联系删除

END

本篇文章来源于微信公众号: AIGC开放社区