马斯克即将发布Grok-1.5,推理能力更强

添加书签

专注AIGC领域的专业社区,关注微软&OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

3月29日,马斯克旗下的AI公司x.ai在官网宣布,未来几天内即将发布Grok-1.5。

前不久,x.ai开源了Grok-1的权重和网络架构,成为大模型开源领域的一匹黑马。即将发布的Grok-1.5在推理、数学、代码等方面大幅度增强,性能和GPT-4差不多。

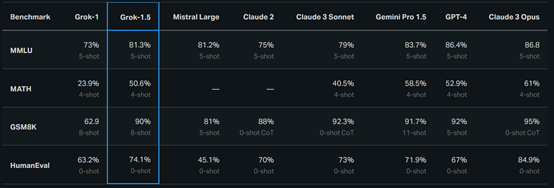

Grok-1.5最显著的改进是在代码和数学相关任务中的表现。在x.ai公布的测试中,Grok-1.5 在 MATH 基准测试中取得了 50.6% 的得分,在 GSM8K 基准测试中取得了 90% 的得分,这两个数学基准测试涵盖了从小学到高中的各种竞赛问题。

此外,在评估代码生成和解决问题能力的 HumanEval 基准测试中,Grok-1.5 获得了 74.1% 的高分,超过了Claude 3 Sonnet、Gemini Pro 1.5和GPT-4三个模型。

更长的上下文理解

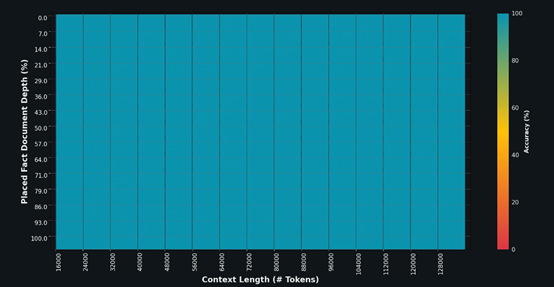

在上下文处理方面,Grok-1.5 可以轻松处理长达 128K 的长上下文,这使得 Grok 的内存容量增加到以前上下文长度的 16 倍,从而帮助用户能够理解更长文档中的信息。

此外,Grok-1.5还能处理更长、更复杂的提示,同时随着上下文窗口的扩大,仍能保持其指令跟踪能力。

在 “大海捞针”(Needle In A Haystack,NIAH)评估中,Grok-1.5展示了强大的检索能力,可检索长度达 128K 字节的上下文中的嵌入文本,并取得了完美的检索结果。

Grok-1.5基础设施

x.ai表示,Grok-1.5 构建在基于 JAX、Rust 和Kubernetes 的自定义分布式训练框架之上。该培训堆栈使研究团队能够以最小的努力构建原型并大规模培训新架构。

在大型计算集群上培训大模型的主要挑战是最大限度地提高培训作业的可靠性和正常运行时间。研究人员自定义训练协调器可确保自动检测到有问题的节点,并将其从训练作业中剔除。同时还优化了检查点、数据加载和训练作业重新启动,以最大限度地减少发生故障时的停机时间。

Grok-1开源

本月18日,马斯克兑现了他的开源诺言,将旗下公司x.ai的大模型Grok-1正式开源,并且支持商业化用途。

开源地址:https://github.com/xai-org/grok-1

Grok-1是一款类ChatGPT的混合专家模型,有3140亿参数,允许商业化,通过文本问答方式可以生成创意文本、代码等。

根据其公布的测试数据显示,性能超过了GPT-3.5、LLaMA 2 70B,弱于GPT-4、Claude 2、Palm 2等闭源模型。

训练数据方面,Grok-1 发布版本所使用的训练数据截至 2023 年第三季度的互联网数据以及xAI人工智能导师提供的数据。

本文素材来源x.ai官网,如有侵权请联系删除

END

本篇文章来源于微信公众号: AIGC开放社区