微软开源新研究:将ChatGPT对话转化为实体机器人动作,“终结者”要来了

添加书签

专注AIGC领域的专业社区,关注GPT-4、百度文心一言、华为盘古等大语言模型(LLM)的发展和应用落地,以及国内LLM的发展和市场研究,欢迎关注!

微软宣布开源了最新研究ChatGPT-Robot-Manipulation-Prompts,可以将人与ChatGPT的自然语言对话,转化为实体机器人动作。(开源地址:https://github.com/microsoft/ChatGPT-Robot-Manipulation-Prompts)

传统模式,想让实体机器人执行人类的命令是基于硬件或特定代码,整体流程非常繁琐、复杂不适合个人用户使用。现在,通过该技术用户只用自然语言,就能指挥机器人执行各种操作,例如,“帮我打开冰箱,拿一杯果汁放在地板上”,机器人能帮你迅速完成这些指令。

微软表示,用ChatGPT的交流方式去控制实体机器人是一个非常大的商业应用场景,这会进一步简化实体机器人的应用流程并增强用户体验。使得每个人都能拥有自己的家用机器人。(论文地址:https://arxiv.org/abs/2304.03893)

微软测试与集成了ChatGPT的实体机器人对话

技术简单介绍

尽管ChatGPT受到了全球数亿人的青睐,但在场景化落地方面较窄目前仅限于软件领域,微软希望通过该研究可以扩大ChatGPT的应用边界,尤其是与物理机器人相结合使用。

从实际应用角度来看,这种无需大量数据收集或模型训练,即可轻松适应多种应用或操作机器人的解决方案非常适用于普通人。

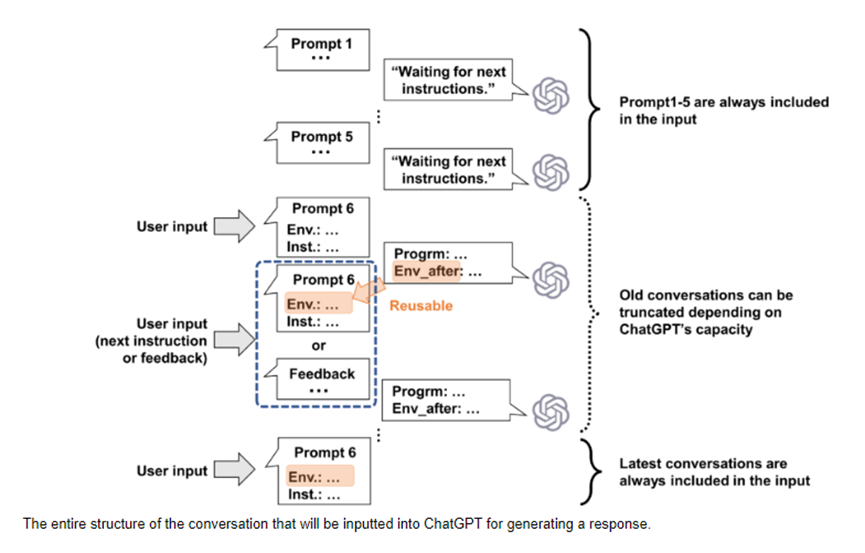

从微软发布的论文来看,其开发了一组多轮对话模板用于ChatGPT与实体机器人交互。对于第2个和后续指令,ChatGPT的下一个响应是根据之前所有对话轮次创建的,允许 ChatGPT 根据自己之前的输出和用户反馈(如果需要)进行更正。

如果输入内容超过 ChatGPT的限制,系统会进行提示用户调整内容大小,同时保留有关更新环境的最新信息。主要技术特性如下:

-

适用于各种家居环境。 -

以可读的JSON格式输出一系列,带有解释的预定义机器人动作。 -

以形式化的方式表示操作环境。 -

推断并输出运行环境的更新状态,可作为下一次输入重复使用,让ChatGPT 仅基于最近操作的记忆进行操作。

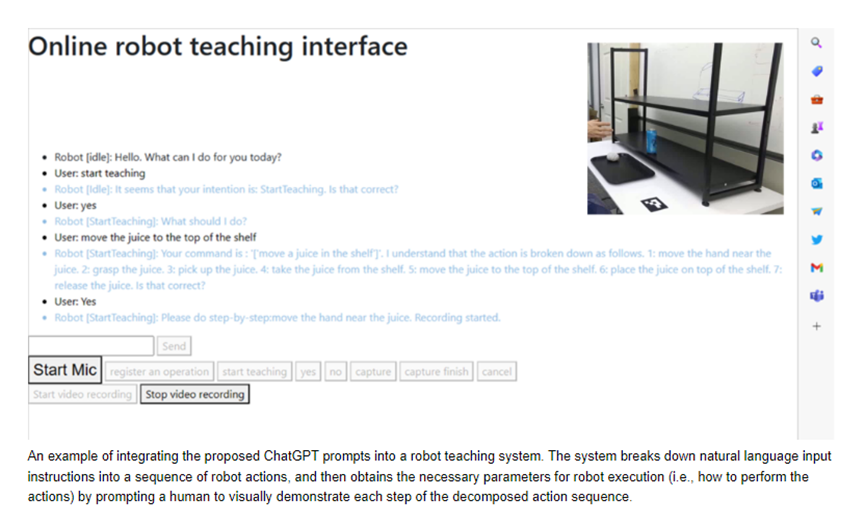

此外,该技术还支持与机器人执行系统或视觉识别程序实现集成,这样做的好处是避免了冗余语言指令以获得视觉和物理参数。

例如,让机器人举高自己的双手。机器人并不知道到底要举高多少,即便是你说出举高20厘米,机器人没有存储数据也是无法做到。

当与视觉识别程序进行集成后,就可以解决这些难题,机器人可以从视觉识别中自动提取要做的详细动作。

用ChatGPT开发物理机器人指令代码

通过软件技术简化物理机器人的使用体验一直是微软的重要发力点。事实上,今年2月份微软就发布了用ChatGPT迭代无人机、机械臂代码的项目,以解决功能迭代的难题。

传统上,要想更改物理机器人的动作、功能,需要专业工程师花费大量时间编写代码、进行繁琐的测试才能完成,借助ChatGPT的自动生成代码能力,可以极大简化这些迭代流程。

该解决方案是:1)定义了一套高级机器人API或函数库。该库可以应用于特定机器人,可以映射到机器人控制堆栈或感知库中。为高级 API 使用描述性名称非常重要,这样 ChatGPT才能推断出它们的行为。

2)为 ChatGPT编写一个文本提示,描述了任务目标,同时说明高级库中的哪些函数可用。还可以提示包含有关任务约束的信息,或 ChatGPT应如何形成答案(特定编码语言,使用辅助解析元素)

3)用户通过使用模拟器评估 ChatGPT的代码输出。如果有问题,用户可以使用自然语言向ChatGPT提供有关代码和安全性的反馈。

当用户觉得ChatGPT生成的代码没有问题时,可以将其部署在物理机器人上。相比传统开发流程,ChatGPT更加高效、实时、易懂,并且非常适用于没有深厚编程背景的普通人。

随着微软将ChatGPT与物理机器人的深度研究,以现在的技术理论上是可以为ChatGPT加上记忆、反思等拟人化能力,如果再加上实体机器身体,我们亲眼见到“终结者”将成为可能。

本文素材来源微软博客,如有侵权请联系删除

END

加入AIGC开放社区交流群

添加微信:13331022201 ,备注“职位信息&名字”

管理员审核后加入讨论群