英伟达出手了!降低ChatGPT等模型非法内容输出,开源NeMo

添加书签

专注AIGC领域的专业社区,关注GPT-4、百度文心一言、华为盘古等大语言模型(LLM)的发展和应用落地,以及国内LLM的发展和市场研究,欢迎关注!

近日,全球著名AI公司NVIDIA(英伟达)在官网宣布开源NeMo Guardrails,以帮助ChatGPT等类似大语言模型支持的应用构建安全体系,降低非法、歧视、不道德等内容输出。(开源地址:https://github.com/NVIDIA/NeMo-Guardrails)

据悉,NeMo Guardrails可以帮助开发人员提升大语言模型支持的应用程序的安全性,包括代码、示例、文档、监控、安全信息过滤等。简单来说,NeMo Guardrails就像高速公路上的“防护围栏”,确保大语言模型能以正确的方式在公路上飞驰,减少各种意外事故发生。

自ChatGPT发布以来NVIDIA成为最大受益者之一,整体市值增长超3,200亿美元。随着ChatGPT应用的深入用户增多,其非法内容输出也呈指数级增长,并受到了多个国家的高度关注,类似的大语言模型也遭遇了相同的窘境。为了帮助自己的“摇钱树”, NVIDIA决定亲自下场解决这些难题。

NeMo Guardrails主要功能介绍

NeMo Guardrails的作用是在用户和大语言模型之间建立一道安全屏障,通过规范形式、监控非法信息、建立规则,帮助大语言模型轻松建立一套安全体系。从而保证大语言模型支持的应用程序能以正确的方式为用户提供服务。

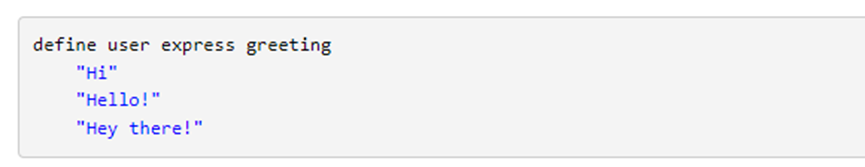

以规范形式为例,下面这段代码展示了问候语的简写,定义了一种新的规范形式express greeting,并提供了一些问候示例,任何类似于给定提示集的信息,都被理解为用户表达了问候。这样做的好处是易于大语言模型理解用户的行为,并建立规范的形式。

NeMo Guardrails主要为开发人员提供了局部护栏、安全护栏和第三方防护三大功能。

局部护栏:可有效防止大语言模型支持的应用程序在特定区域功能进行防护,例如,不让客服助理回应有关赌博的内容。

安全护栏:确保内容的准确、安全、可靠,例如,可以过滤掉一些暴力、非法的关键词,并减少虚假信息的生成。

第三方安全防护:可将大语言模型支持的应用程序限制为,仅与已知安全的外部第三方应用程序建立连接,减少非法应用的接入。

在功能使用方面,开发人员无需繁琐的配置或拥有机器学习知识,只需要几行代码就能快速建立规则。NeMo Guardrails的兼容性非常强适配所有主流开发工具,例如,在LangChain框架中使用。

与NVIDIA NeMo框架相结合

NVIDIA还将NeMo Guardrails与大语言模型开发平台NVIDIA NeMo相结合使用,保证开发者构建的基础模型的安全性。

NeMo是一个端到端的云原生开发框架,用于构建、定制和部署具有数十亿参数的生成式 AI模型。(体验地址:https://developer.nvidia.com/nemo)

NeMo框架为使用3D并行技术进行训练,提供了加速的工作流程。它提供了多种定制技术的选择,并针对语言和图像应用程序的大模型的推理进行了优化,具有多GPU和多节点配置,在开发、部署方面非常高效。

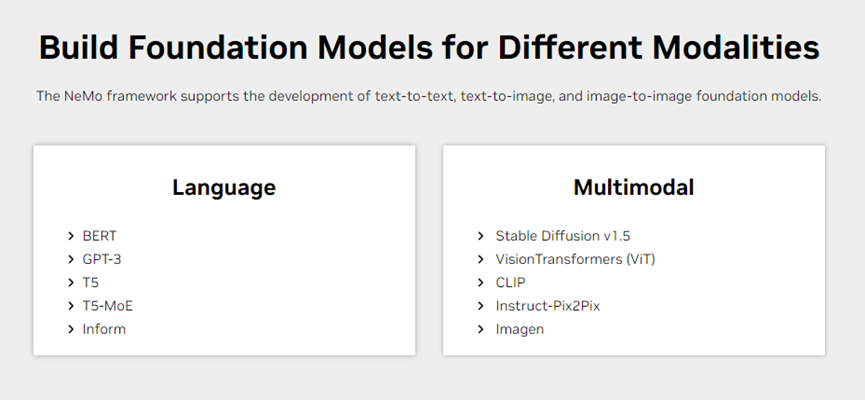

NeMo支持BERT、GPT-3、T5、T5-MoE、Inform、Stable Diffusion v1.5、VisionTransformers (ViT) 、CLIP等目前主流文本、图像大语言模型的开发。支持,文本到文本、文本到图像、图像到图像的多模态开发。

例如,韩国一家领先的电信运营商通过NeMo平台,开发了一个由大语言模型支持的智能客服助手。目前该助手已与客户进行了800万次的对话,极大提升了工作效率。

本文素材来源NVIDIA官网,如有侵权请联系删除

END