类ChatGPT开源平台MosaicML,以13亿美元被Databricks收购!

添加书签

专注AIGC领域的专业社区,关注OpenAI、百度文心一言等大语言模型(LLM)的发展和应用落地,关注LLM的基准评测和市场研究,欢迎关注!

6月27日,著名数据和AI企业Databricks在官网宣布,以13亿美元(约94亿元)价格收购了类ChatGPT开源平台MosaicML。

收购完成后,MosaicML的所有团队包括研发、市场、销售等全部加入Databricks公司,将一起努力为全球客户提供预训练、微调、大语言模型等服务。

本次交易是全球生成式AI赛道第一笔超过10亿美元的收购。随着Meta、IBM、甲骨文、百度、阿里巴巴、Salesforce、SAP、埃森哲、亚马逊、普华永道、毕马威等科技、咨询巨头的陆续进场,这种“大鱼吃小鱼”的收购好戏还将继续上演。

这也标志着由微软、谷歌展开的“生成式AI大战”的影响不断加深、扩大,马太效应也越发明显,留给初创公司的窗口不断缩小。

Databricks原文收购价格

Databricks原文收购价格

MosaicML曾在今年5月5日发布了类ChatGPT开源大语言模型MPT-7B。(开源地址:https://huggingface.co/mosaicml/mpt-7b)该项目具备可商业化、高性能、资源消耗低、1T训练数据、可生成代码等技术优势。MPT-7B 在MosaicML平台上进行了9.5天的训练,零人工干预,成本仅用了20万美元。

截至目前,MPT-7B开源项目的下载量超过300万次,AI2、Generally Intelligence、Hippocratic AI、Replit 和 Scatter Labs等知名客户皆使用其产品,开发各种生成式AI产品。Databricks表示,这也是收购MosaicML的重要原因之一。

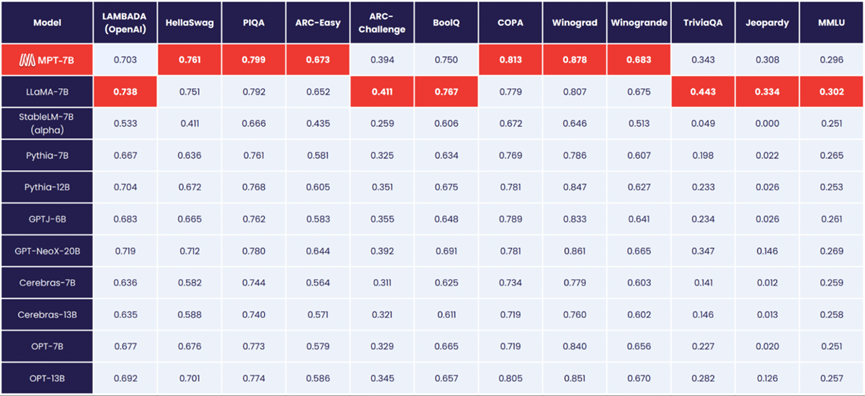

性能方面,MPT-7B与LLaMA-7B、StablelM-7B (alpha) 、Pythia-7B 、Pythia-128、 GPTJ-68、GPT-Neox-208、Cerebras-7B、 Cerebras-13B、OPT-7B、OPT-138同类产品进行了比较,在6个项目中优于其他模型,基本与LLaMA-7B性能持平。

支持84k tokens超长输入,并用FlashAttention和FasterTransformer方法针对训练和推理速度做过优化。

训练数据方面,MPT-7B使用了混合数据源,包括C4、维基百科、CommonCrawl、arXiv、Books和StackExchange等数据集,并且该模型针对1万亿个标记进行了预训练。

为了使模型具备代码生成的能力,MPT-7B还使用了The Stack的6.4TB的代码数据集,删除了包含的2.9TB重复数据。

该代码数据集包含358种编程语言,例如,C、C++、Java、Ruby、Scala、Scheme、Shell、Python等。

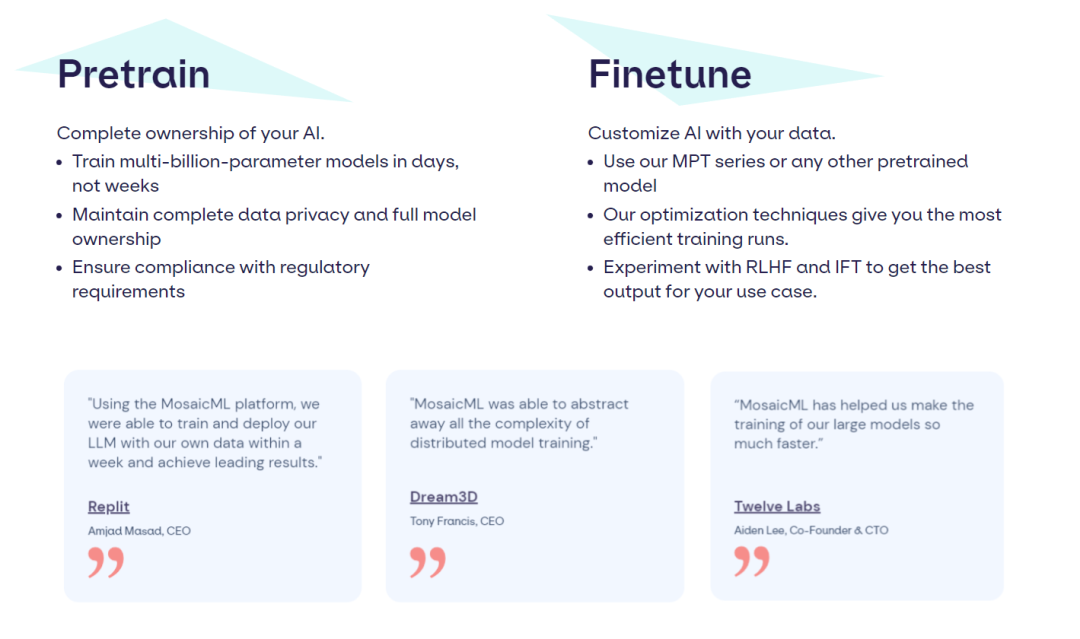

此外,MosaicML还提供大语言模型微调和预训练服务,支持云部署和完整数据隐私控制等。

通过此次收购,MosaicML将其高性能开源项目与Databricks的平台进行深度融合,为客户提供简单、易用、安全、稳定和可解释的生成式AI服务。

同时提供大语言模型训练、资源整合等服务,企业使用其平台可将训练速度提升2.7倍左右,数十亿参数的模型可在几个小时就能完成,训练费用仅需几千美元,而不是上百万美元,极大地降低了生成式AI的开发成本。

Databricks联合创始人兼首席执行官 Ali Ghodsi表示,每个组织都应该能够从AI中受益,并对其数据的使用方式有更多的控制。Databricks 和 MosaicML 拥有实现AI民主化的绝佳机会,并为全球企业提供安全、可靠的大语言模型服务。

关于Databricks

Databricks创立于2013年,总部位于美国旧金山,在全球多个国家、地区设有办事处。其企业客户超过9000家。

Databricks提供了统一的分析平台,该平台是为大规模数据处理和机器学习而设计的。Databricks 平台简化了数据处理和机器学习工作流程,使数据科学家、数据工程师和商业分析师能够更轻松地协作和实现他们的目标。

Databricks已经在多个行业中得到了应用,包括金融服务、医疗保健、媒体和娱乐、零售、科技等。

本文素材来源Databricks官网,如有侵权请联系删除

END